👉点击这里申请火山引擎VIP帐号,立即体验火山引擎产品>>>

背景信息

软件要求

NVIDIA驱动:

GPU驱动:用来驱动NVIDIA GPU卡的程序。本文以535.86.10为例。

CUDA:使GPU能够解决复杂计算问题的计算平台。本文以CUDA 12.2为例。

CUDNN:深度神经网络库,用于实现高性能GPU加速。本文以8.5.0.96为例。

运行环境:

Transformers:一种神经网络架构,用于语言建模、文本生成和机器翻译等任务。本文以4.30.2为例。

Pytorch:开源的Python机器学习库,实现强大的GPU加速的同时还支持动态神经网络。本文以2.0.1为例。

Anaconda:获取包且对包能够进行管理的工具,包含了Conda、Python在内的超过180个科学包及其依赖项,用于创建Python虚拟环境。本文以Anaconda 3和Python 3.10为例。

Pytorch使用CUDA进行GPU加速时,在CUDA、GPU驱动已经安装的情况下,依然不能使用,很可能是版本不匹配的问题,请严格关注以上软件的版本匹配情况。

使用说明

操作步骤

步骤一:创建GPU计算型实例

基础配置:

计算规格:ecs.gni2.3xlarge

镜像:Ubuntu 20.04,不勾选“后台自动安装GPU驱动”。

存储:云盘容量在100 GiB以上。

网络配置:勾选“分配弹性公网IP”。

步骤二:安装GPU驱动和CUDA工具包

登录实例。

执行以下命令,下载CUDA Toolkit。

CUDA Toolkit大小约4G,其中已经包含了GPU驱动和CUDA,安装过程相对耗时,请耐心等待。

执行以下命令,安装GPU驱动和CUDA。

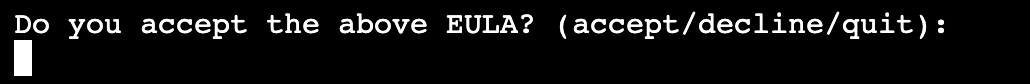

输入"accept"确认信息。

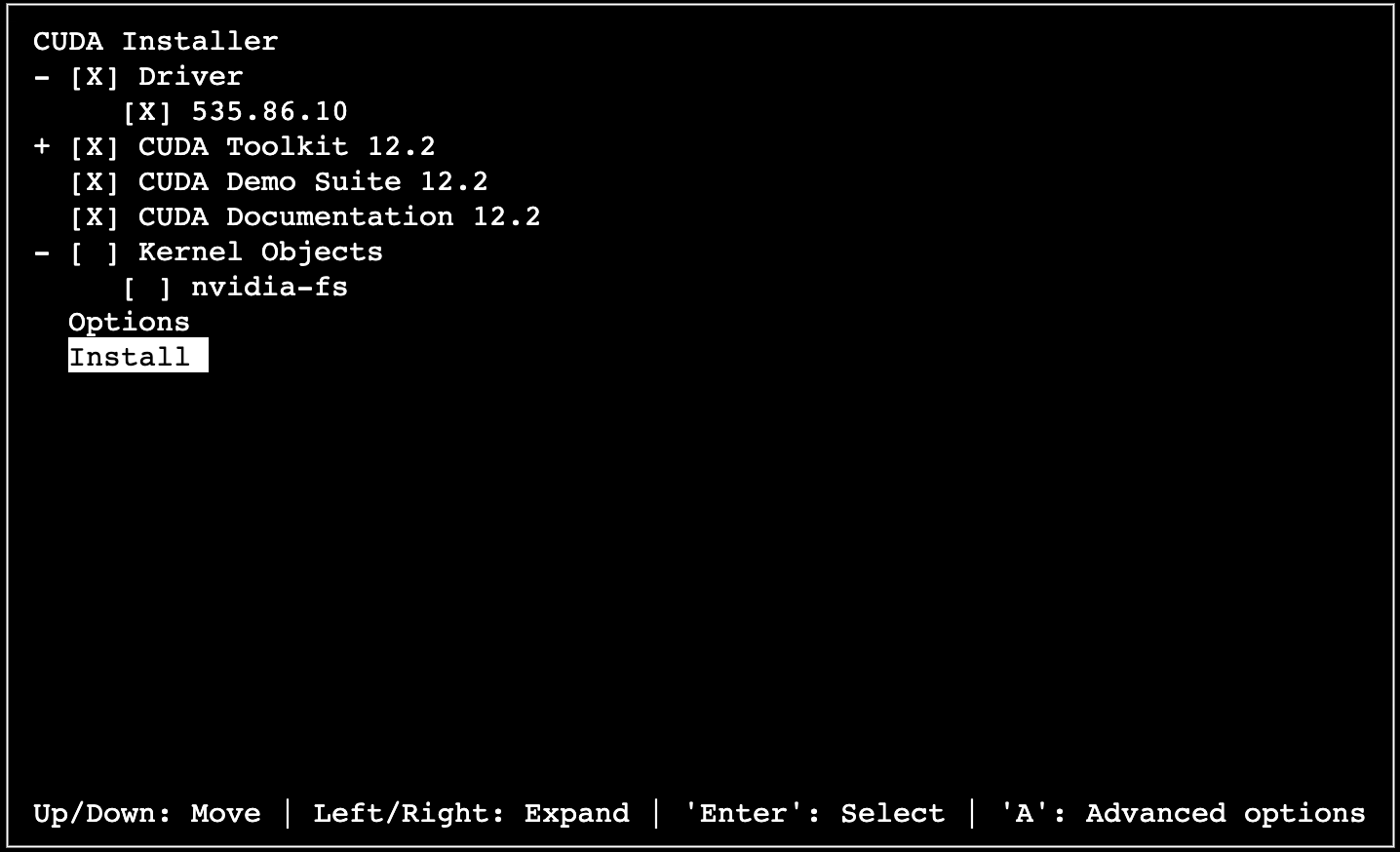

按键盘上下键选中【Install】,回车确认,开始安装。

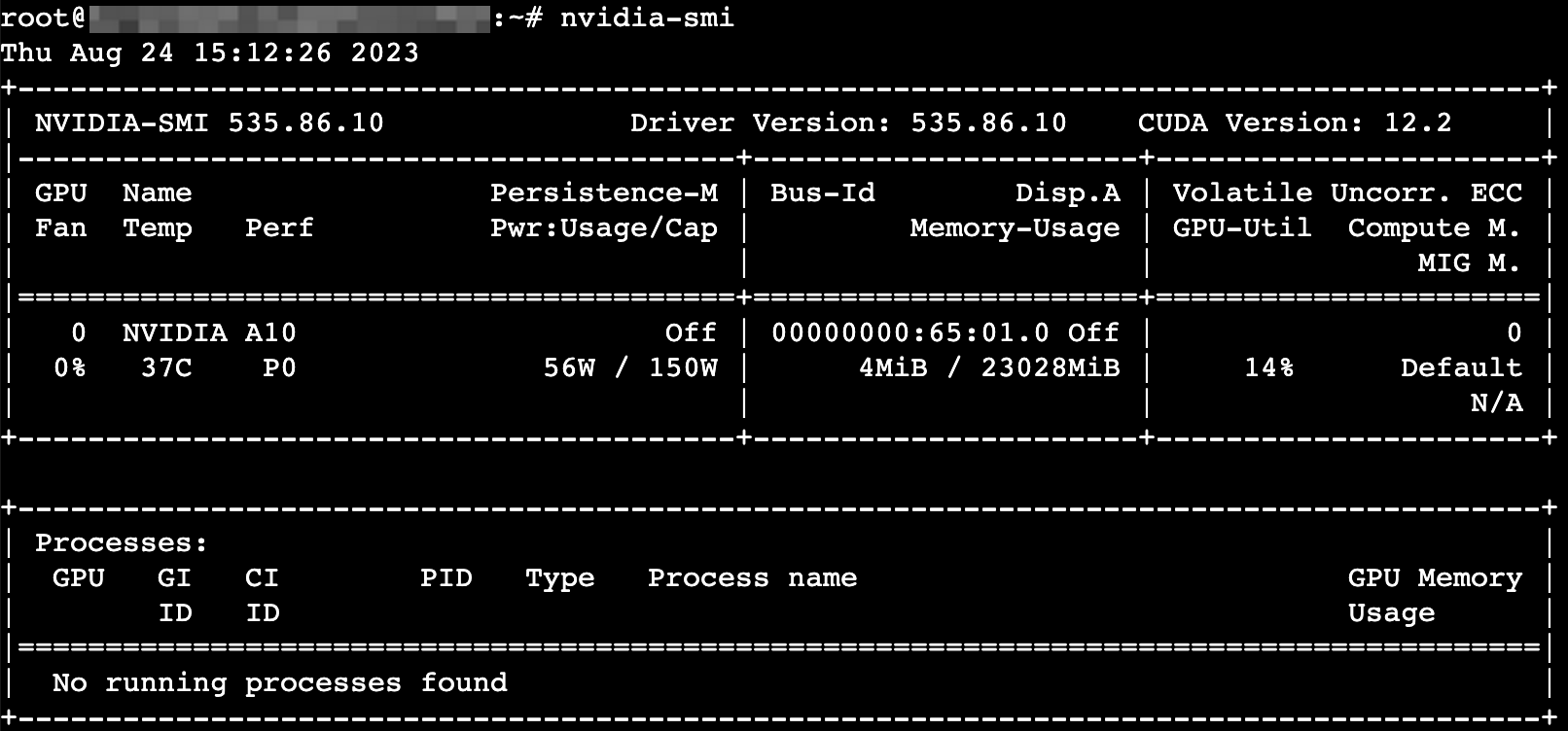

安装完成后,执行以下命令进行验证。

步骤三:创建虚拟环境

执行以下命令,下载Anaconda安装包。

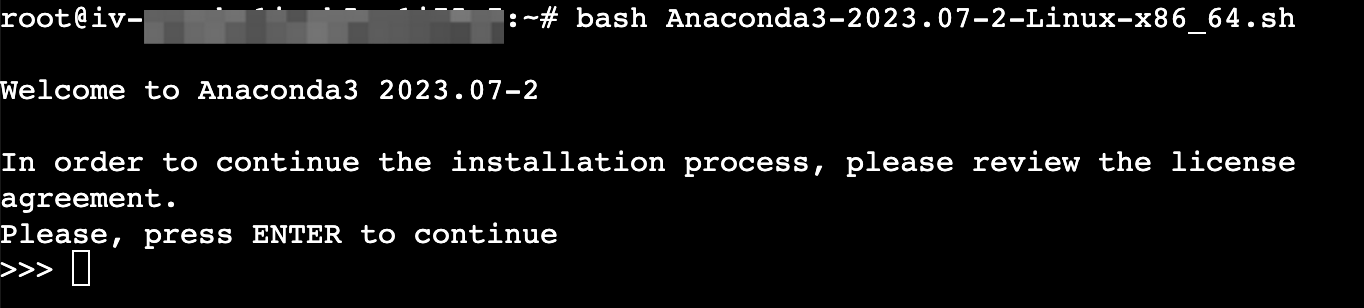

执行以下命令,安装Anaconda。

持续按“Enter”键进行安装。

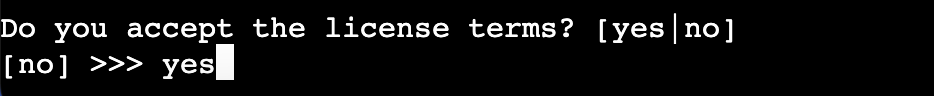

输入“yes”确认信息。

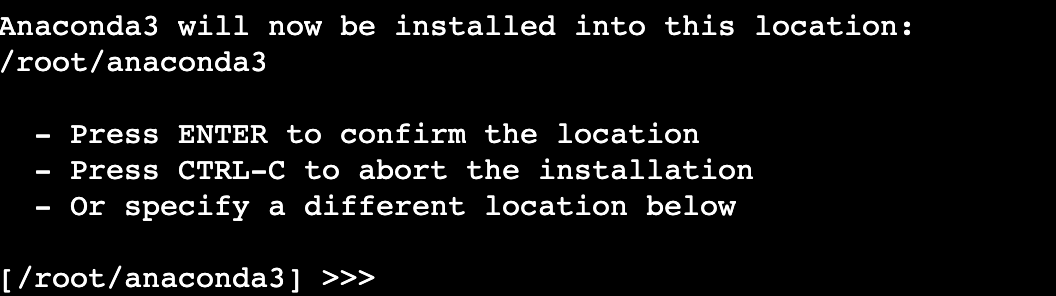

Anaconda的安装路径/root/anaconda3,请按“Enter”确认安装。

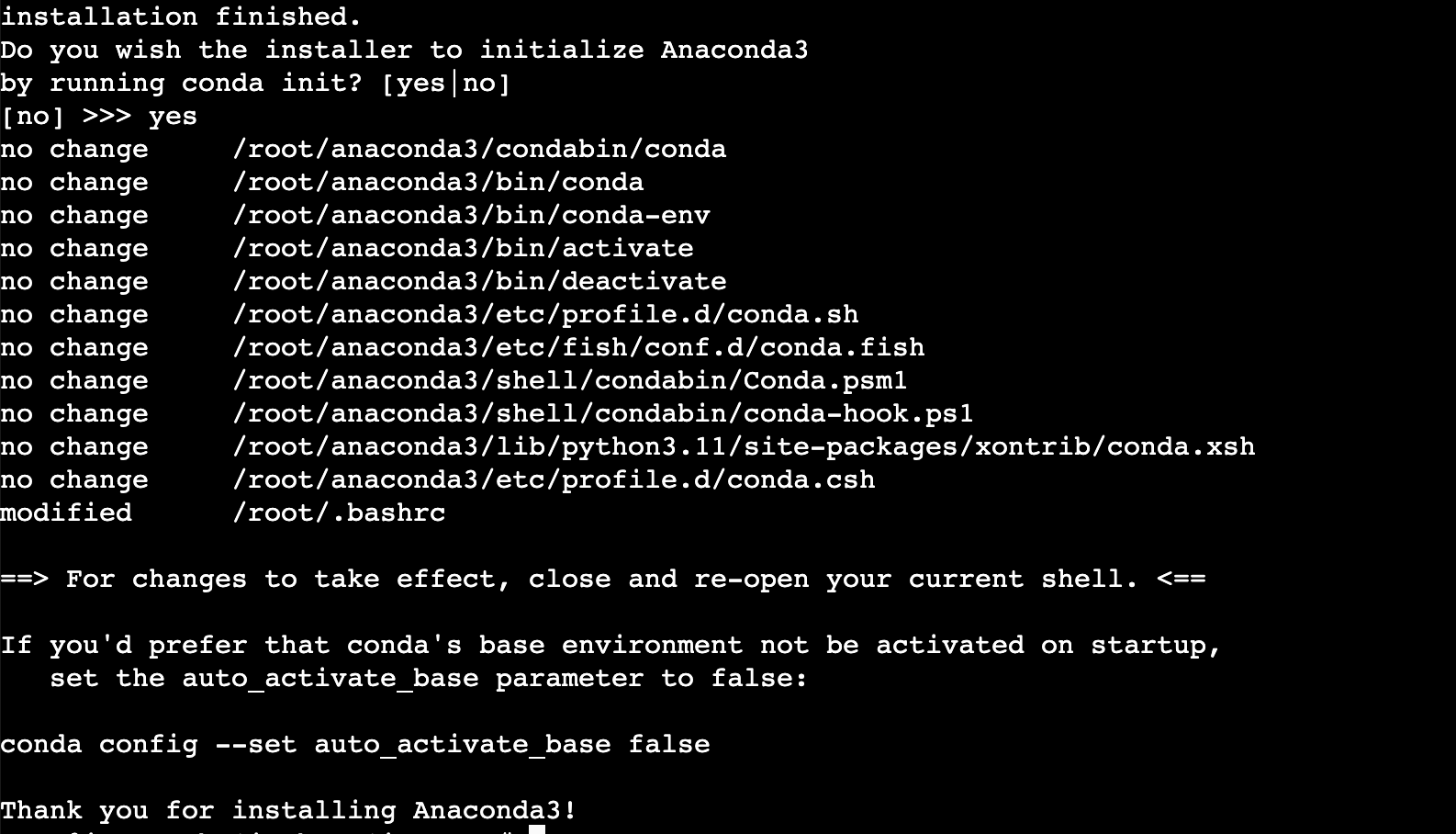

输入“yes”确定初始化Anaconda。

执行以下命令使配置文件生效。

创建一个名为“ChatGLMtest”的虚拟环境,并指定该环境中的python版本为3.10。

执行conda create -n ChatGLMtest python=3.10命令。

回显Proceed ([y]/n)?时输入“y”确认。

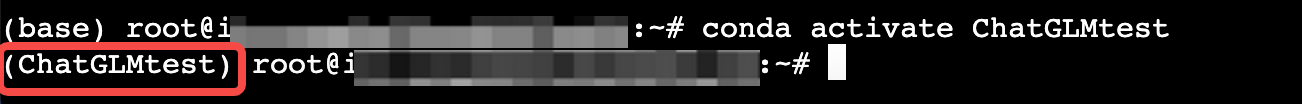

执行以下命令,激活虚拟环境。

步骤四:部署模型并验证

依次执行以下命令,安装Git。

apt-get update # 更新安装包列表apt-get install git # 安装gitapt-get install git-lfs # 安装git-lfs

执行以下命令初始化Git LFS。

执行以下命令,下载ChatGLM2-6B大模型的权重文件。

执行以下命令,下载官方示例代码。

依次执行以下命令,安装相应的依赖包。

cd /root/ChatGLM2-6B # 工作目录切换到示例代码的路径pip install -r requirements.txt # 安装ChatGLM依赖

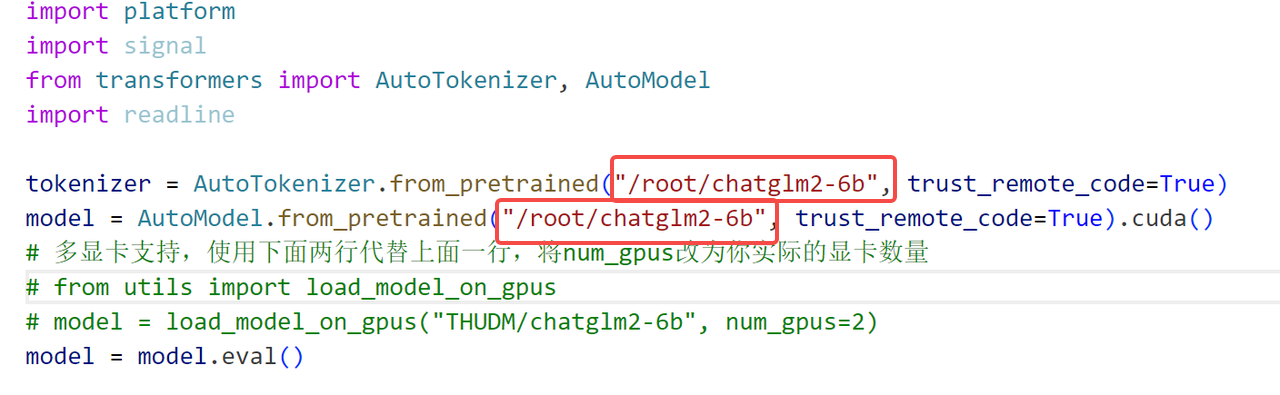

修改示例代码路径,加载本地ChatGLM2-6B模型。

执行vim cli_demo.py打开demo文件。

按i进入编辑模式,将文件中的/THUDM/chatglm2-6b替换为本地文件夹的路径/root/chatglm2-6b。

按esc退出编辑模式,输入:wq并按Enter键,保存并退出文件。

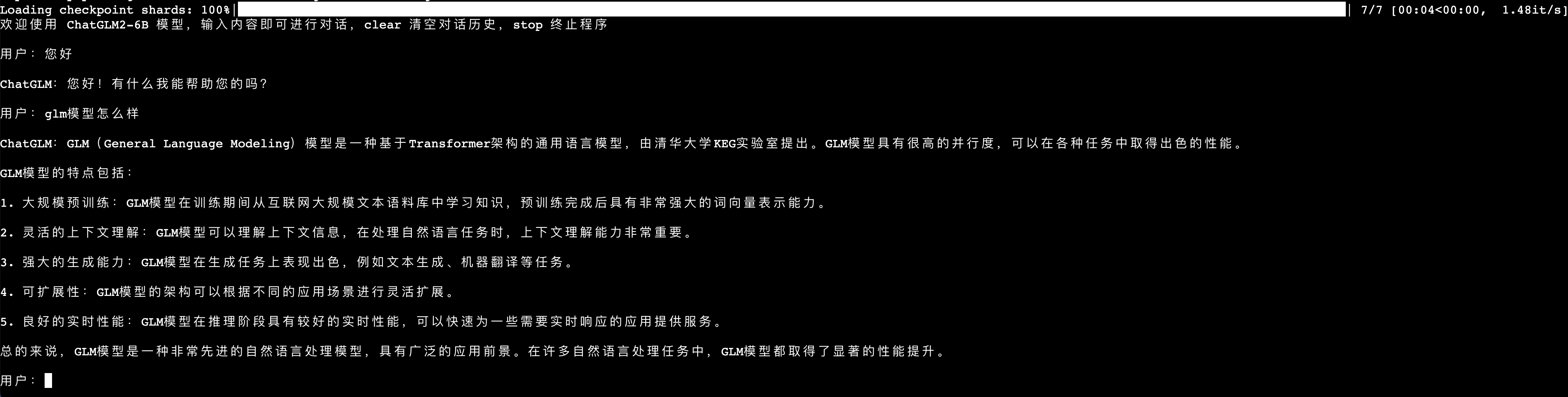

执行以下命令,运行示例代码中的“cli_demo.py”。